Το Ομοσπονδιακό Γραφείο Ερευνών των ΗΠΑ (FBI) προειδοποιεί για την αύξηση των εκστρατειών εκβιασμού, με τους εγκληματίες να αξιοποιούν τα εργαλεία τεχνητής νοημοσύνης (AI) για να δημιουργήσουν απομιμήσεις σεξουαλικού περιεχομένου από αθώες φωτογραφίες ή βίντεο ανθρώπων και στη συνέχεια να τους παρενοχλήσουν ή να τους εκβιάσουν.

Σύμφωνα με την πρόσφατη ανακοίνωση, το FBI έχει λάβει μεγάλο αριθμό αναφορών από θύματα «των οποίων οι φωτογραφίες ή τα βίντεο αλλοιώθηκαν». Τα βίντεο, στα οποία εμφανίζονται τόσο ενήλικες όσο και ανήλικοι, κυκλοφορούν στα μέσα κοινωνικής δικτύωσης ή σε ιστοσελίδες πορνογραφικού περιεχομένου.

Πόσο κοστίζει ένα βίντεο deepfake στο dark web

«Ανησυχητικό είναι το γεγονός ότι η ταχέως αναπτυσσόμενη τεχνολογία επιτρέπει σχεδόν σε οποιονδήποτε να δημιουργήσει παραποιημένο σεξουαλικό περιεχόμενο που φαίνεται να περιλαμβάνει ενήλικες χωρίς τη συγκατάθεσή τους, ακόμη και παιδιά» λέει ο Phil Muncaster από την ομάδα της εταιρίας ψηφιακής ασφάλειας ESET. Αυτό οδηγεί στη συνέχεια σε παρενοχλήσεις, εκβιασμούς και σεξουαλικό εκβιασμό (sextortion).

Μερικές φορές το θύμα βρίσκει το περιεχόμενο μόνο του, μερικές φορές το ειδοποιεί κάποιος άλλος και μερικές φορές ο κακόβουλος δράστης επικοινωνεί μαζί του.

Αυτό που συμβαίνει στη συνέχεια είναι ένα από τα εξής δύο πράγματα:

Ο κακόβουλος δράστης απαιτεί να του δώσετε:

- χρήματα απειλώντας ότι θα μοιραστεί το περιεχόμενο με φίλους και συγγενείς.

- ή/και γνήσιες φωτογραφίες ή βίντεο σεξουαλικού περιεχομένου.

Στην τελευταία περίπτωση μπορεί να έχουμε σεξουαλικό εκβιασμό (sextortion), μια μορφή εκβιασμού όπου ο δράστης της απειλής εξαπατά ή εξαναγκάζει το θύμα να μοιραστεί σεξουαλικό περιεχόμενο και στη συνέχεια απειλεί να το δημοσιοποιήσει, εκτός αν το θύμα πληρώσει ή στείλει περισσότερες φωτογραφίες/βίντεο. «Πρόκειται για άλλη μια ταχέως αναπτυσσόμενη τάση για την οποία το FBI αναγκάστηκε να εκδώσει προειδοποιήσεις κατά τη διάρκεια του περασμένου έτους» προειδοποιεί ο ειδικός της ESET.

Συνήθως στις περιπτώσεις sextortion, το θύμα γίνεται φίλος στο διαδίκτυο με ένα άτομο που προσποιείται ότι είναι κάποιος άλλος. Ο απατεώνας ξεγελά το θύμα, μέχρι να καταφέρει να λάβει τις αποκαλυπτικές φωτογραφίες/βίντεο. Στην περίπτωση του εκβιασμού με τη βοήθεια deepfake, οι ψεύτικες εικόνες είναι το μέσο με το οποίο τα θύματα εκβιάζονται – δε χρειάζεται να είστε φίλοι στα κοινωνικά μέσα.

Σε μια σχετική σημείωση, ορισμένοι εγκληματίες διαπράττουν απάτες sextortion που περιλαμβάνουν μηνύματα ηλεκτρονικού ταχυδρομείου στα οποία ισχυρίζονται ότι έχουν εγκαταστήσει κακόβουλο λογισμικό στον υπολογιστή του θύματος, το οποίο υποτίθεται ότι τους επέτρεψε να καταγράψουν το άτομο να παρακολουθεί πορνογραφικό περιεχόμενο. Περιλαμβάνουν προσωπικά στοιχεία, όπως έναν παλιό κωδικό πρόσβασης ηλεκτρονικού ταχυδρομείου που απέκτησαν από μια παλιά παραβίαση δεδομένων, προκειμένου να κάνουν την απειλή – που σχεδόν πάντα είναι κενή – να φαίνεται πιο ρεαλιστική. Το φαινόμενο των ηλεκτρονικών μηνυμάτων απάτης σεξουαλικού εκβιασμού προέκυψε από την αυξημένη ευαισθητοποίηση του κοινού για την απάτη sextortion.

Το πρόβλημα με τα deepfakes

Τα Deepfakes δημιουργούνται με τη χρήση νευρωνικών δικτύων (neural networks), τα οποία επιτρέπουν στους χρήστες να πλαστογραφούν αποτελεσματικά την εμφάνιση ή τον ήχο ενός ατόμου. Στην περίπτωση του οπτικού περιεχομένου, εκπαιδεύονται να λαμβάνουν εισερχόμενο βίντεο, να το συμπιέζουν μέσω ενός κωδικοποιητή και στη συνέχεια να το αναδομούν με έναν αποκωδικοποιητή. Αυτό θα μπορούσε να χρησιμοποιηθεί για την αποτελεσματική μεταφορά του προσώπου ενός στόχου στο σώμα κάποιου άλλου, και να τον βάλει να μιμηθεί τις ίδιες κινήσεις του προσώπου του τελευταίου.

Η τεχνολογία υπάρχει εδώ και καιρό. Ένα παράδειγμα ήταν ένα viral βίντεο με τον Τομ Κρουζ να παίζει γκολφ, να κάνει μαγικά και να τρώει γλειφιτζούρια, και συγκέντρωσε εκατομμύρια προβολές πριν αφαιρεθεί. Η τεχνολογία έχει, βέβαια, χρησιμοποιηθεί και για την εισαγωγή των προσώπων διασημοτήτων και άλλων ανθρώπων σε άσεμνα βίντεο.

Τα κακά νέα είναι ότι η τεχνολογία γίνεται όλο και πιο εύκολα διαθέσιμη στον καθένα και ωριμάζει σε σημείο που οι αρχάριοι μπορούν να τη χρησιμοποιήσουν με αρκετά πειστικά αποτελέσματα. Αυτός είναι ο λόγος για τον οποίο το FBI (και όχι μόνο) ανησυχεί.

Πως να μην πέσετε θύμα των deepfakes

Μόλις κυκλοφορήσει ένα τέτοιο συνθετικό περιεχόμενο, τα θύματα μπορεί να αντιμετωπίσουν «σημαντικές προκλήσεις για την αποτροπή της αναπαραγωγής του παραποιημένου περιεχομένου ή την απομάκρυνσή του στο διαδίκτυο». Αυτό μπορεί να είναι πιο δύσκολο στις ΗΠΑ απ’ ό,τι στην ΕΕ, όπου οι κανόνες του GDPR σχετικά με το «δικαίωμα στη διαγραφή» επιβάλλουν στους παρόχους υπηρεσιών να κατεβάζουν συγκεκριμένο περιεχόμενο κατόπιν αιτήματος του ατόμου. Ωστόσο, ακόμη και έτσι, πρόκειται για μια οδυνηρή εμπειρία για τους γονείς ή τα παιδιά.

Στον ψηφιακό κόσμο που είναι πάντα σε κίνηση και πρέπει να μοιράζεται περιεχόμενο, πολλοί από εμάς πατάμε το κουμπί της δημοσίευσης και δημιουργούμε ένα βουνό από προσωπικά βίντεο και φωτογραφίες που βρίσκονται σε όλο το διαδίκτυο. Αυτά είναι αρκετά αθώα, αλλά δυστυχώς, πολλές από αυτές τις εικόνες και τα βίντεο είναι εύκολα διαθέσιμα για να τα δει ο καθένας. Αυτοί που έχουν κακόβουλες προθέσεις φαίνεται να βρίσκουν πάντα έναν τρόπο να χρησιμοποιούν αυτά τα στοιχεία και τη διαθέσιμη τεχνολογία για κακό σκοπό. Με αυτό τον τρόπο δημιουργούνται πολλά deepfakes, καθώς, αυτές τις μέρες, όποιος θέλει μπορεί να δημιουργήσει τέτοιο περιεχόμενο.

Καλύτερα να προλάβετε την τάση τώρα, για να ελαχιστοποιήσετε την πιθανή ζημιά σε εσάς και την οικογένειά σας. «Εξετάστε τα παρακάτω βήματα για να μειώσετε τον κίνδυνο να πέσετε θύμα deepfake εξαρχής και να ελαχιστοποιήσετε τις πιθανές επιπτώσεις αν συμβεί το χειρότερο σενάριο» προτείνει ο Muncaster από την ESET:

Για εσάς:

- Σκεφτείτε πολύ καλά πριν δημοσιεύετε φωτογραφίες, βίντεο και άλλο περιεχόμενο. Το πιο αθώο περιεχόμενο θα μπορούσε θεωρητικά να χρησιμοποιηθεί από κακόβουλους δρώντες χωρίς τη συγκατάθεσή σας για να μετατραπεί σε deepfake.

- Ενημερωθείτε για τις ρυθμίσεις απορρήτου στους λογαριασμούς σας στα μέσα κοινωνικής δικτύωσης. Είναι λογικό να κάνετε τα προφίλ και τις λίστες φίλων ιδιωτικές, ώστε οι φωτογραφίες και τα βίντεο να κοινοποιούνται μόνο σε όσους γνωρίζετε.

- Να είστε πάντα προσεκτικοί όταν δέχεστε αιτήματα φιλίας από άτομα που δεν γνωρίζετε.

- Ποτέ μην στέλνετε περιεχόμενο σε άτομα που δεν γνωρίζετε. Να είστε ιδιαίτερα επιφυλακτικοί απέναντι σε άτομα που ασκούν πίεση για να δουν συγκεκριμένο περιεχόμενο.

- Να είστε επιφυλακτικοί με «φίλους» που αρχίζουν να συμπεριφέρονται ασυνήθιστα στο διαδίκτυο. Ο λογαριασμός τους μπορεί να έχει παραβιαστεί και να έχει χρησιμοποιηθεί για να αποσπάσει περιεχόμενο και άλλες πληροφορίες.

- Χρησιμοποιείτε πάντα σύνθετους, μοναδικούς κωδικούς πρόσβασης και έλεγχο ταυτότητας πολλαπλών παραγόντων (MFA) για να προστατέψετε τους λογαριασμούς σας στα μέσα κοινωνικής δικτύωσης.

- Πραγματοποιείτε τακτικές αναζητήσεις για τον εαυτό σας στο διαδίκτυο για να εντοπίζετε τυχόν προσωπικές πληροφορίες ή περιεχόμενο βίντεο/φωτογραφιών που είναι διαθέσιμο δημόσια.

- Εξετάστε το ενδεχόμενο αντίστροφης αναζήτησης εικόνων για να βρείτε τυχόν φωτογραφίες ή βίντεο που έχουν δημοσιευτεί στο διαδίκτυο χωρίς να το γνωρίζετε.

- Μην στέλνετε ποτέ χρήματα ή φωτογραφίες/video σε άγνωστα άτομα. Το μόνο που θα καταφέρετε θα είναι να σας ζητήσουν περισσότερα.

- Αναφέρετε οποιαδήποτε δραστηριότητα εκβιασμού στην αστυνομία και στην αντίστοιχη πλατφόρμα κοινωνικής δικτύωσης.

- Αναφέρετε το περιεχόμενο deepfake στην/στις πλατφόρμα/ες στην/στις οποία/ες δημοσιεύτηκε.

Για τους γονείς:

- Πραγματοποιήστε τακτικές διαδικτυακές αναζητήσεις για τα παιδιά σας για να εντοπίσετε πόσες προσωπικές πληροφορίες και περιεχόμενο είναι δημόσια διαθέσιμα στο διαδίκτυο.

- Παρακολουθήστε την ηλεκτρονική δραστηριότητα των παιδιών σας, σε λογικά πλαίσια, και συζητήστε μαζί τους τους κινδύνους που σχετίζονται με την κοινοποίηση προσωπικού περιεχομένου.

- Σκεφτείτε διπλά τη δημοσίευση περιεχομένου των παιδιών σας στο οποίο είναι ορατά τα πρόσωπά τους.

Η φθηνή τεχνολογία deepfake θα συνεχίσει να βελτιώνεται «εκδημοκρατίζοντας» τον εκβιασμό και την παρενόχληση. Ίσως είναι το τίμημα που πληρώνουμε για ένα ανοιχτό διαδίκτυο. Αλλά, ενεργώντας πιο προσεκτικά μπορούμε να μειώσουμε τις πιθανότητες να συμβεί κάτι κακό.

Latest News

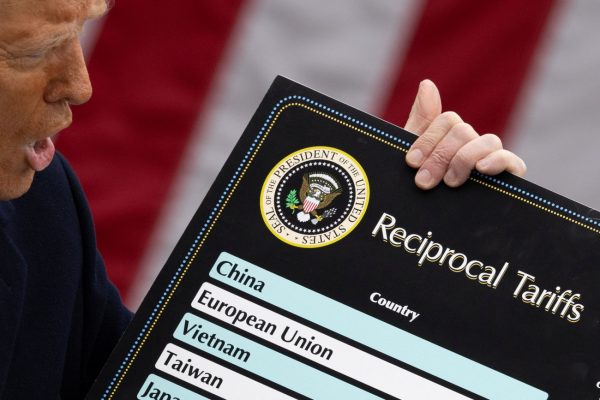

Τα... καμάρια της Silicon Valley δεν πλήρωσαν φόρους εκατοντάδων δισ. δολαρίων

Οι κορυφαίες αμερικανικές εταιρείες τεχνολογίας, γνωστές ως Silicon Six, δημιουργούν κέρδη δισεκατομμυρίων, αλλά «κλέβουν» το δημόσιο ταμείο

Ξεπέρασαν τις 15.000 οι επισκέπτες στη Beyond 2025

Η BEYOND 2025 συγκέντρωσε περισσότερους από 300 εκθέτες από την Ελλάδα και από 10 χώρες

Πώς θα προστατευτείτε από ηλεκτρονικές απάτες σε καιρούς οικονομικής αβεβαιότητας

Επιτήδειοι με κακούς σκοπούς μπορεί να επιχειρήσουν να εκμεταλλευτούν την κατάσταση και οι χρήστες να πέσουν θύματα σε ηλεκτρονικές απάτες

Οι start-ups που δημιουργούν εργαλεία παραγωγικότητας είναι το νέο μεγάλο στοίχημα της ΑΙ - Ποιες είναι

Οι επενδυτές ποντάρουν σε AI startups που αναπτύσσουν πρακτικές εφαρμογές της ΑΙ αναζητώντας μεγάλα κέρδη χωρίς τεράστιες δαπάνες

Τα 5 πράγματα που δεν πρέπει να μοιράζεστε ποτέ με την τεχνητή νοημοσύνη

To ChatGPT, όπως και άλλα εργαλεία τεχνητής νοημοσύνης, εξελίσσονται χρησιμοποιούνται από όλο και περισσότερους ανθρώπους για μια ευρεία γκάμα αναζητήσεων

Ποιες είναι οι 10 χώρες με τα περισσότερα ταλέντα στην AI

Έρευνα της Microsoft, με τη συμμετοχή 31.000 ατόμων σε 31 χώρες, έδειξε ότι το 66% των επιχειρήσεων δεν θα προσλάμβανε κάποιον χωρίς δεξιότητες στην τεχνητή νοημοσύνη

Η συμβολή της ΑΙ στην κατανόηση της σεισμικής κρίσης στη Σαντορίνη

Τα πρώτα αποτελέσματα της χρήση υψηλής τεχνολογίας και τεχνητής νοημοσύνης στην παρακολούθηση της σεισμικής δραστηριότητας στη Σαντορίνη

Alphabet και Nvidia επενδύουν στην εταιρεία του Σάτσκεβερ, συνιδρυτή της OpenAI

Σύμφωνα με το Reuters, Alphabet και Nvidia επενδύουν στην SSI του Ίλια Σάτσκεβερ που είχε αποχωρήσει πέρυσι από την OpenAI δημιουργό του ChatGTP

Πισσαρίδης (LSE): Η μάχη για την AI κερδίζεται με επενδύσεις και αλλαγές

Για την ανάγκη επενδύσεων στην Τεχνητή Νοημοσύνη και τα βήματα που πρέπει να κάνει η Ευρώπη ώστε να μη χάσει ακόμα περισσότερο έδαφος από τις ΗΠΑ, μίλησε ο Χριστόφορος Πισσαρίδης, Regius Professor, London School of Economics and Political Science

Παπαστεργίου: Ειδική γραμματεία για την AI στο υπουργείο Ψηφιακής Διακυβέρνησης

«Η Ελλάδα είναι ένα τρένο που ξεκινάει σιγά σιγά και θα τρέξει γρήγορα. Το μόνο που πρέπει να κάνουμε είναι να αντιμετωπίσουμε ενδεχόμενα προβλήματα για να μην χάσουμε χρόνο», σημείωσε ο κ. Ππαστεργίου

Αριθμός Πιστοποίησης

Αριθμός Πιστοποίησης