Η OpenAI δημιούργησε μια επιτροπή ασφάλειας και προστασίας (ομάδα superalignment όπως ήταν γνωστή πριν διαλυθεί), της οποίας θα ηγείται ο διευθύνων σύμβουλος Σαμ Άλτμαν, καθώς ξεκινά την εκπαίδευση του επόμενου μοντέλου τεχνητής νοημοσύνης της, σύμφωνα με τα όσα ανακοίνωσε η εταιρεία

Οι διευθυντές Bret Taylor, Adam D’Angelo και Nicole Seligman, είναι επίσης της επιτροπής, ανέφερε η OpenAI, σύμφωνα με το Reuters.

xAI: Η startup του Μασκ που φιλοδοξεί να ανταγωνιστεί την Open AI

Νωρίτερα αυτόν τον μήνα αποχώρησαν από την εταιρεία ο πρώην επικεφαλής επιστήμονας Ilya Sutskever και ο Jan Leike, επικεφαλής της ομάδας Superalignment της OpenAI, η οποία εξασφάλιζε ότι η τεχνητή νοημοσύνη παρέμενε ευθυγραμμισμένη με τους επιδιωκόμενους στόχους της εταιρείας.

Η OpenAI είχε διαλύσει την ομάδα Superalignment νωρίτερα τον Μάιο, λιγότερο από ένα χρόνο μετά τη δημιουργία της, με ορισμένα μέλη της ομάδας να μετατίθενται σε άλλες ομάδες.

Ο ρόλος της νέας επιτροπής

Η επιτροπή θα είναι υπεύθυνη για τη διατύπωση συστάσεων προς το διοικητικό συμβούλιο σχετικά με τις αποφάσεις για την ασφάλεια και την προστασία των έργων και των λειτουργιών της OpenAI.

Το πρώτο της καθήκον θα είναι να αξιολογήσει και να αναπτύξει περαιτέρω τις υπάρχουσες πρακτικές ασφαλείας της OpenAI κατά τις επόμενες 90 ημέρες και στη συνέχεια θα μοιραστεί τις συστάσεις με το συμβούλιο.

Μετά την αξιολόγηση από το ΔΣ, η OpenAI θα μοιραστεί δημόσια μια ενημέρωση σχετικά με τις υιοθετημένες συστάσεις.

Άλλα μέλη της επιτροπής είναι οι τεχνικοί και πολιτικοί εμπειρογνώμονες της εταιρείας Aleksander Madry, Lilian Weng και ο επικεφαλής των επιστημών ευθυγράμμισης John Schulman. Ο νεοδιορισθείς επικεφαλής επιστήμονας Jakub Pachocki και ο επικεφαλής ασφάλειας Matt Knight θα συμμετέχουν επίσης στην επιτροπή.

Latest News

Η Harley-Davidson, μόνη, ψάχνει νέο... CEO

Γιατί ο Γιόχεν Ζάιτς σχεδιάζει να αποσυρθεί μετά από πέντε χρόνια στη θέση του Διευθύνοντος Συμβούλου της Harley-Davidson

Πρώην αρχικατάσκοπος της CIA σε ρόλο κλειδί στην KKR

Η επενδυτική - διαχειριστές χρημάτων KKR προσέλαβε στο Ντέιβιντ Πετρέους για να επιβλέψει τομέα Από τον οποίο προσδοκά τεράστια ανάπτυξη

![F-35: Το ακριβό μαχητικό που διεκδικούν αρκετές χώρες [γράφημα]](https://www.ot.gr/wp-content/uploads/2025/03/f-35-1-600x400.jpg)

Οι παραγγελίες του F-35 - Ενα ακριβό μαχητικό που διεκδικούν αρκετές χώρες [γράφημα]

Η συνολική παραγγελία της αμερικανικής πολεμικής αεροπορίας για τα αεροσκάφη F-35 προς την κατασκευάστρια εταιρεία Lockheed Martin, φτάνει τις 1.763 μονάδες

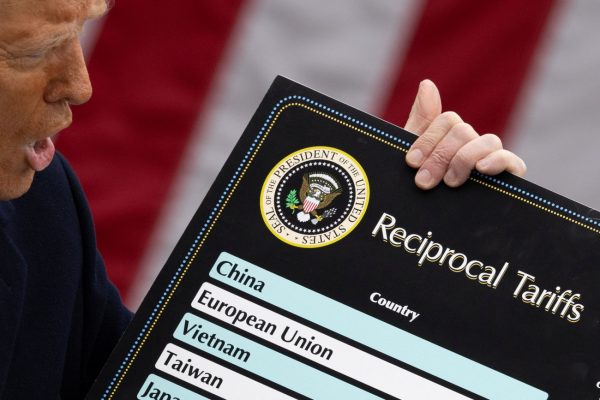

Οι δασμοί δεν θα φέρουν πίσω στις ΗΠΑ την παραγωγή - Τι λένε οι αμερικανοί επιχειρηματίες

Η επαναφορά των αλυσίδων εφοδιασμού στις ΗΠΑ θα μπορούσε να διπλασιάσει το κόστος - Αντί για αυτό οι επιχειρηματίες προτιμού να αναζητήσουν χώρες με χαμηλούς δασμούς

Η «βαριοπούλα» των δασμών συντρίβει την παγκόσμια τάξη πραγμάτων - Τι λέει η ING

Τις τελευταίες δύο εβδομάδες ο κόσμος βιώνει μια βόλτα με το τρενάκι του τρόμου, σημειώνουν οι αναλυτές της ING

Οργισμένοι επενδυτές της Stellantis για πληρωμή μαμούθ στον πρώην CEO

Ο πρώην CEO της Stellantis θα λάβει υπέρογκη αμοιβή την στιγμή που οι επενδυτές τον θεωρούν υπεύθυνο για σειρά αποτυχιών και μείωση κερδοφορίας

Το Netflix στοχεύει σε κεφαλαιοποίηση $1 τρισεκατομμυρίου

Το Netflix μοιράζεται στόχους οικονομικών επιδόσεων με το προσωπικό τονίζοντας την κυριαρχία της

Γιατί συρρικνώνονται τα σπίτια των Αμερικανών

Το αμερικανικό όνειρο της ιδιοκτησίας σπιτιού μειώνεται λόγω κρίσης οικονομικής προσιτότητας στις ΗΠΑ

Προειδοποίηση Ντίμον για τον εμπορικό πόλεμο - «Οι ΗΠΑ μπορεί να χάσουν την ηγετική τους θέση»

Ο Ντίμον εκτίμησε ότι ο εμπορικός πόλεμος μπορεί να βλάψει την φερεγγυότητα των ΗΠΑ και κάλεσε σε προσέγγιση ΗΠΑ-Πεκίνου

Οι δασμοί θα φέρουν χάος στις παραδόσεις αεροσκαφών λέει ο CEO της Ryanair

Αεροπορικές εταιρείες και κατασκευαστές αεροπλάνων ετοιμάζονται να παλέψουν για το ποιος πληρώνει για τους δασμούς

Αριθμός Πιστοποίησης

Αριθμός Πιστοποίησης