Τον περασμένο Ιούλιο ο Χένρι Κίσινγκερ ταξίδεψε στο Πεκίνο για τελευταία φορά πριν από το θάνατό του. Μεταξύ των μηνυμάτων που παρέδωσε στον ηγέτη της Κίνας, Xi Jinping, ήταν μία προειδοποίηση για τους καταστροφικούς κινδύνους της τεχνητής νοημοσύνης (AI), σύμφωνα με τον Economist.

Τεχνητή νοημοσύνη: Γιατί οι εργαζόμενοι την βλέπουν ως τροχοπέδη

Έκτοτε, αμερικανικά αφεντικά τεχνολογίας και πρώην κυβερνητικοί αξιωματούχοι συναντήθηκαν ήσυχα με τους Κινέζους ομολόγους τους σε μια σειρά άτυπων συναντήσεων που ονομάστηκαν Διάλογοι του Κίσινγκερ. Οι συζητήσεις επικεντρώθηκαν εν μέρει στον τρόπο προστασίας του κόσμου από τους κινδύνους της τεχνητής νοημοσύνης.

Στις 27 Αυγούστου, Αμερικανοί και Κινέζοι αξιωματούχοι αναμένεται να ασχοληθούν με το θέμα (μαζί με πολλούς άλλους) όταν ο σύμβουλος εθνικής ασφάλειας της Αμερικής, Τζέικ Σάλιβαν, ταξιδέψει στο Πεκίνο.

«Επιταχυντές» και «καταστροφείς»

Πολλοί στον κόσμο της τεχνολογίας πιστεύουν ότι η τεχνητή νοημοσύνη θα φτάσει να ταιριάζει ή να ξεπεράσει τις γνωστικές ικανότητες των ανθρώπων. Ορισμένοι προγραμματιστές προβλέπουν ότι τα μοντέλα τεχνητής γενικής νοημοσύνης (AGI) θα είναι μια μέρα σε θέση να μάθουν, γεγονός που θα μπορούσε να τα καταστήσει ανεξέλεγκτα. Όσοι πιστεύουν ότι, αν αφεθεί ανεξέλεγκτη, η τεχνητή νοημοσύνη αποτελεί υπαρξιακό κίνδυνο για την ανθρωπότητα ονομάζονται «καταστροφείς».

Τείνουν να υποστηρίζουν αυστηρότερους κανονισμούς. Από την άλλη πλευρά είναι οι «επιταχυντές», οι οποίοι τονίζουν τη δυνατότητα της τεχνητής νοημοσύνης να ωφελήσει την ανθρωπότητα.

Οι δυτικοί επιταχυντές συχνά υποστηρίζουν ότι ο ανταγωνισμός με τους κινέζους κατασκευαστές, οι οποίοι δεν παρεμποδίζονται από ισχυρές διασφαλίσεις, είναι τόσο έντονος που η Δύση δεν έχει την πολυτέλεια να επιβραδύνει. Το συμπέρασμα είναι ότι η συζήτηση στην Κίνα είναι μονόπλευρη, με τους υποστηρικτές της επιτάχυνσης να έχουν τον μεγαλύτερο λόγο στο ρυθμιστικό περιβάλλον. Στην πραγματικότητα, η Κίνα έχει τους δικούς της καταστροφείς AI – και έχουν όλο και μεγαλύτερη επιρροή.

Μέχρι πρόσφατα, οι ρυθμιστικές αρχές της Κίνας επικεντρώνονταν στον κίνδυνο των αδίστακτων chatbots που λένε πολιτικά μη ορθά πράγματα για το Κομμουνιστικό Κόμμα, παρά στον κίνδυνο των μοντέλων αιχμής να ξεφύγουν από τον ανθρώπινο έλεγχο.

Το 2023 η κυβέρνηση απαίτησε από τους προγραμματιστές να καταχωρήσουν τα μεγάλα γλωσσικά μοντέλα τους. Οι αλγόριθμοι σημειώνονται τακτικά για το πόσο καλά συμμορφώνονται με τις σοσιαλιστικές αξίες και αν θα μπορούσαν να «ανατρέψουν την κρατική εξουσία». Οι κανόνες αποσκοπούν επίσης στην πρόληψη των διακρίσεων και των διαρροών δεδομένων πελατών. Αλλά, γενικά, οι κανονισμοί ασφάλειας AI είναι ευέλικτοι. Ορισμένοι από τους πιο επαχθείς περιορισμούς της Κίνας καταργήθηκαν πέρυσι.

Οι επιταχυντές της Κίνας θέλουν να κρατήσουν τα πράγματα έτσι. Ο Zhu Songchun, σύμβουλος του κόμματος και διευθυντής ενός προγράμματος που υποστηρίζεται από το κράτος για την ανάπτυξη της AGI, υποστήριξε ότι η ανάπτυξη της τεχνητής νοημοσύνης είναι εξίσου σημαντική με το έργο «Δύο βόμβες, ένας δορυφόρος», μια ώθηση της εποχής του Μάο για την παραγωγή πυρηνικών όπλων μεγάλου βεληνεκούς.

Νωρίτερα φέτος, ο Yin Hejun, υπουργός Επιστήμης και Τεχνολογίας, χρησιμοποίησε ένα παλιό σύνθημα του κόμματος για να πιέσει για ταχύτερη πρόοδο, γράφοντας ότι η ανάπτυξη, συμπεριλαμβανομένου του τομέα της τεχνητής νοημοσύνης, ήταν η μεγαλύτερη πηγή ασφάλειας της Κίνας. Ορισμένοι υπεύθυνοι χάραξης οικονομικής πολιτικής προειδοποιούν ότι η υπερβολική επιδίωξη της ασφάλειας θα βλάψει την ανταγωνιστικότητα της Κίνας.

Αλλά οι επιταχυντές δέχονται αντίσταση από μια κλίκα ελίτ επιστημόνων με το αυτί του Κομμουνιστικού Κόμματος. Ο πιο σημαντικός ανάμεσά τους είναι ο Andrew Chi-Chih Yao, ο μόνος Κινέζος που έχει κερδίσει το βραβείο Turing για την πρόοδο στην επιστήμη των υπολογιστών. Τον Ιούλιο, ο κ. Yao δήλωσε ότι η τεχνητή νοημοσύνη ενέχει μεγαλύτερο υπαρξιακό κίνδυνο για τον άνθρωπο από τα πυρηνικά ή βιολογικά όπλα.

Ο Zhang Ya-Qin, πρώην πρόεδρος της Baidu, ενός κινεζικού τεχνολογικού γίγαντα, και ο Xue Lan, πρόεδρος της επιτροπής εμπειρογνωμόνων του κράτους για τη διακυβέρνηση της τεχνητής νοημοσύνης, εκτιμούν επίσης ότι η τεχνητή νοημοσύνη μπορεί να απειλήσει την ανθρώπινη φυλή. Ο Yi Zeng της Κινεζικής Ακαδημίας Επιστημών πιστεύει ότι τα μοντέλα AGI θα δουν τελικά τους ανθρώπους όπως οι άνθρωποι βλέπουν τα μυρμήγκια.

Μία αέναη συζήτηση

Εάν η Κίνα προχωρήσει με τις προσπάθειες περιορισμού της πιο προηγμένης έρευνας και ανάπτυξης AI, θα έχει προχωρήσει περισσότερο από οποιαδήποτε άλλη μεγάλη χώρα. Ο Σι λέει ότι θέλει να «ενισχύσει τη διακυβέρνηση των κανόνων τεχνητής νοημοσύνης στο πλαίσιο των Ηνωμένων Εθνών». Για να γίνει αυτό, η Κίνα θα πρέπει να συνεργαστεί στενότερα με άλλους. Αλλά η Αμερική και οι φίλοι της εξακολουθούν να εξετάζουν το ζήτημα. Η συζήτηση μεταξύ καταστροφέων και επιταχυντών, στην Κίνα και αλλού, απέχει πολύ από το να τελειώσει.

Latest News

Γιατί η Samsung επιδιώκει τεχνολογική συμμαχία με κορυφαία πανεπιστήμια των ΗΠΑ

Η πρωτοβουλία έχει σχεδιαστεί για να διευκολύνει τη μετατόπιση του επιχειρηματικού στόχου της Samsung από ακόλουθο σε πρωτοπόρο

Η Silicon Valley θέλει να δημιουργήσει ρομποτικό στρατό για τους «καλούς τύπους» με σύμμαχο την ΑΙ

H Silicon Valley έχει κάνει σημαντική στροφή προς την άμυνα τα τελευταία χρόνια με επενδύσεις εκατοντάδων δισεκατομμυρίων

Η Huawei έτοιμη να προωθήσει προηγμένο τσιπ τεχνητής νοημοσύνης

Το νέο τσιπ τεχνητής νοημοσύνης 910C που ετοιμάζει η Huawei έρχεται τη στιγμή που η Κίνα αναζητά εναλλακτικές λύσεις στα τσιπ της Nvidia

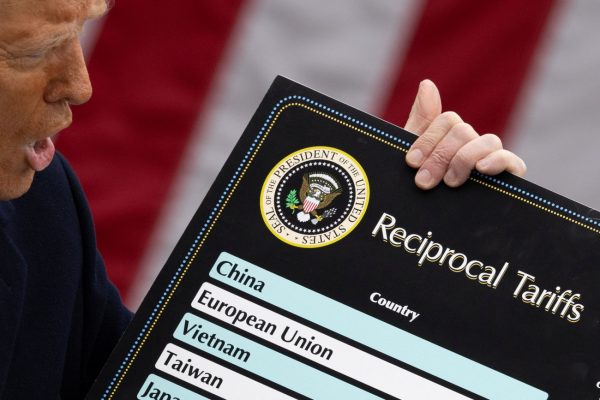

Στις συμπληγάδες ΗΠΑ - Κίνας ο γίγαντας των ημιαγωγών Nvidia - Τι ζητά ο Χουάνγκ στο Πεκίνο;

Ο Τζένσεν Χουάνγκ, CEO της Nvidia, θα απαιτήσει άδειες για να εξάγει το μικροτσίπ H20 AI στην Κίνα

Ιταλική εφημερίδα δημοσίευσε ένθετο γραμμένο από ΑΙ

Μετά τον πρώτο μήνα δοκιμών, η ιταλική εφημερίδα Il Foglio προσέλαβε το σύστημα ως μόνιμο υπάλληλο.

Η Δικαιοσύνη αναβαθμίζεται ψηφιακά με συστήματα AI

Μέχρι σήμερα, η μετάφραση εκατοντάδων, αν όχι χιλιάδων, σελίδων και η αναζήτηση διαθέσιμων μεταφραστών και διερμηνέων, ειδικά σε κάποιες γλώσσες, προκαλεί σημαντικές καθυστερήσεις

Ξεκινά η υλοποίηση του ελληνικού εργοστασίου τεχνητής νοημοσύνης

Το AI Factory «Pharos» είναι ένα από τα πρώτα δεκατρία «εργοστάσια» Τεχνητής Νοημοσύνης στην Ευρώπη

Η TDK φέρνει επανάσταση στη δημιουργική ΑΙ

Η TDK κατέγραψε χρόνους απόκρισης 20 τρισεκατομμυρίων του δευτερολέπτου στη δοκιμή για τη βελτίωση των ταχυτήτων μεταφοράς δεδομένων

Ξεπέρασαν τις 15.000 οι επισκέπτες στη Beyond 2025

Η BEYOND 2025 συγκέντρωσε περισσότερους από 300 εκθέτες από την Ελλάδα και από 10 χώρες

Οι start-ups που δημιουργούν εργαλεία παραγωγικότητας είναι το νέο μεγάλο στοίχημα της ΑΙ - Ποιες είναι

Οι επενδυτές ποντάρουν σε AI startups που αναπτύσσουν πρακτικές εφαρμογές της ΑΙ αναζητώντας μεγάλα κέρδη χωρίς τεράστιες δαπάνες

![Πλημμύρες: Σημειώθηκαν σε επίπεδα ρεκόρ στην Ευρώπη το 2024 [γράφημα]](https://www.ot.gr/wp-content/uploads/2025/04/FLOOD_HUNGRY-90x90.jpg)

![Ξενοδοχεία: Μεγάλο το ενδιαφέρον για επενδύσεις στην Ελλάδα – Η θέση της Αθήνας [γραφήματα]](https://www.ot.gr/wp-content/uploads/2025/03/Athens-hotels-90x90.jpg)

Αριθμός Πιστοποίησης

Αριθμός Πιστοποίησης