Η OpenAI ανακοίνωσε τη Δευτέρα ότι η Επιτροπή Ασφάλειας και Ασφάλειας, την οποία παρουσίασε η εταιρεία τον Μάιο καθώς αντιμετώπιζε επικρίσεις σχετικά με τις διαδικασίες ασφαλείας, γίνεται πλέον ανεξάρτητη επιτροπή εποπτείας του διοικητικού συμβουλίου.

Πρόεδρος της ομάδας θα είναι ο Ζίκο Κόλτερ, διευθυντής του τμήματος μηχανικής μάθησης στη σχολή επιστήμης υπολογιστών του Πανεπιστημίου Carnegie Mellon. Άλλα μέλη είναι ο Άνταμ Ντ’ Άντζελο, μέλος του διοικητικού συμβουλίου της OpenAI και συνιδρυτής της Quora, ο πρώην επικεφαλής της NSA και μέλος του διοικητικού συμβουλίου Πολ Νακασόν και η Νικόλ Σέλιγκμαν, πρώην εκτελεστική αντιπρόεδρος της Sony.

Ανταγωνίστρια της OpenAI ιδρύει ο Ίλια Σατσκέβερ

Η επιτροπή θα επιβλέπει «τις διαδικασίες ασφάλειας που καθοδηγούν την ανάπτυξη μοντέλων της OpenAI», ανέφερε η εταιρεία. Πρόσφατα ολοκλήρωσε την επισκόπηση των 90 ημερών αξιολογώντας τις διαδικασίες και τις δικλείδες ασφαλείας της OpenAI και στη συνέχεια έκανε συστάσεις στο συμβούλιο. Η OpenAI δημοσιεύει τα ευρήματα της ομάδας ως δημόσια ανάρτηση.

Η OpenAI και ο νέος γύρος επενδύσεων

Η OpenAI, η startup που βρίσκεται πίσω από τα εργαλεία τεχνητής νοημοσύνης ChatGPT και το SearchGPT έχοντας την υποστήριξη κολοσσών όπως η Microsoft, επιδιώκει επί του παρόντος έναν γύρο χρηματοδότησης που θα αποτιμήσει την εταιρεία σε περισσότερα από 150 δισεκατομμύρια δολάρια, σύμφωνα με πηγές του CNBC.

Η Thrive Capital ηγείται του γύρου και σχεδιάζει να επενδύσει 1 δισεκατομμύριο δολάρια, ενώ η Tiger Global σχεδιάζει να συμμετάσχει επίσης. Η Microsoft, η Nvidia και η Apple φέρεται να βρίσκονται επίσης σε συνομιλίες για πρόσθετες επενδύσεις.

Οι πέντε βασικές συστάσεις

Οι πέντε βασικές συστάσεις της επιτροπής περιελάμβαναν την ανάγκη δημιουργίας ανεξάρτητης διακυβέρνησης για την ασφάλεια, την ενίσχυση των μέτρων ασφαλείας, τη διαφάνεια σχετικά με το έργο της OpenAI, τη συνεργασία με εξωτερικούς οργανισμούς. και να ενοποιήσει τα πλαίσια ασφαλείας της εταιρείας.

Την περασμένη εβδομάδα, το OpenAI κυκλοφόρησε το o1, μια έκδοση προεπισκόπησης του νέου μοντέλου τεχνητής νοημοσύνης που επικεντρώνεται στη συλλογιστική και την «λύση σκληρών προβλημάτων».

Η εταιρεία είπε ότι η επιτροπή «εξέτασε τα κριτήρια ασφάλειας που χρησιμοποίησε η OpenAI για να αξιολογήσει την καταλληλότητα του o1 ώστε να λανσαριστεί», καθώς και τα αποτελέσματα αξιολόγησης ασφάλειας.

Η επιτροπή «μαζί με το πλήρες συμβούλιο, θα ασκεί επίβλεψη των λανσαρισμάτων μοντέλων, συμπεριλαμβανομένης της εξουσίας να καθυστερεί την κυκλοφορία μέχρι να αντιμετωπιστούν οι ανησυχίες για την ασφάλεια».

Οι ανησυχίες για την ασφάλεια

Ενώ η OpenAI βρισκόταν σε λειτουργία υπερ-ανάπτυξης από τα τέλη του 2022, όταν κυκλοφόρησε το ChatGPT, είναι ταυτόχρονα γεμάτο διαμάχες και αποχωρήσεις υψηλού επιπέδου εργαζομένων, με ορισμένους νυν και πρώην υπαλλήλους να ανησυχούν ότι η εταιρεία αναπτύσσεται πολύ γρήγορα για να λειτουργεί με ασφάλεια.

Τον Ιούλιο, Δημοκρατικοί γερουσιαστές έστειλαν επιστολή στον διευθύνοντα σύμβουλο της OpenAI, Σαμ Άλτμαν, σχετικά με «ερωτήσεις για το πώς η OpenAI αντιμετωπίζει τις αναδυόμενες ανησυχίες για την ασφάλεια». Τον προηγούμενο μήνα, μια ομάδα νυν και πρώην υπαλλήλων της OpenAI δημοσίευσε ανοιχτή επιστολή που περιγράφει ανησυχίες σχετικά με την έλλειψη εποπτείας και την απουσία προστασίας από τους καταγγέλλοντες για όσους θέλουν να μιλήσουν.

Τον Μάιο, ένα πρώην μέλος του διοικητικού συμβουλίου τηςOpenAI, μιλώντας για την προσωρινή απομάκρυνση του Άλτμαν τον Νοέμβριο, είπε ότι έδωσε στο διοικητικό συμβούλιο «ανακριβείς πληροφορίες σχετικά με τον μικρό αριθμό επίσημων διαδικασιών ασφαλείας που είχε εφαρμόσει η εταιρεία» σε πολλές περιπτώσεις.

Εκείνο τον μήνα, η εταιρεία αποφάσισε να διαλύσει την ομάδα της που επικεντρώθηκε στους μακροπρόθεσμους κινδύνους της τεχνητής νοημοσύνης μόλις ένα χρόνο μετά την ανακοίνωση του ομίλου. Οι ηγέτες της ομάδας, Ίλια Σάτσκεβερ και Γιαν Λέικε, ανακοίνωσαν την αποχώρησή τους από την OpenAI τον Μάιο. Ο Λέικε έγραψε σε ανάρτηση στο X ότι η «κουλτούρα και οι διαδικασίες ασφάλειας της OpenAI έχουν πάρει πίσω ένα μέρος από τη λάμψη των προϊόντων».

Latest News

Η TDK φέρνει επανάσταση στη δημιουργική ΑΙ

Η TDK κατέγραψε χρόνους απόκρισης 20 τρισεκατομμυρίων του δευτερολέπτου στη δοκιμή για τη βελτίωση των ταχυτήτων μεταφοράς δεδομένων

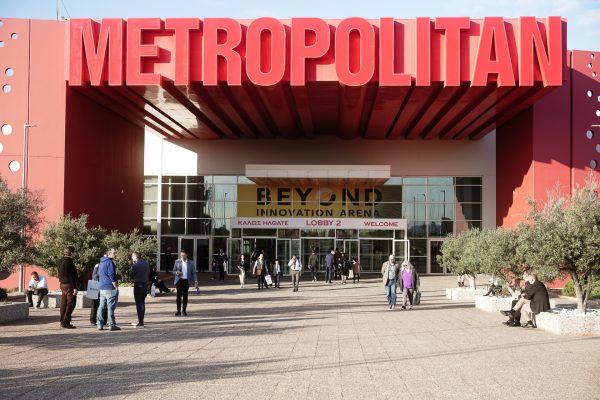

Ξεπέρασαν τις 15.000 οι επισκέπτες στη Beyond 2025

Η BEYOND 2025 συγκέντρωσε περισσότερους από 300 εκθέτες από την Ελλάδα και από 10 χώρες

Οι start-ups που δημιουργούν εργαλεία παραγωγικότητας είναι το νέο μεγάλο στοίχημα της ΑΙ - Ποιες είναι

Οι επενδυτές ποντάρουν σε AI startups που αναπτύσσουν πρακτικές εφαρμογές της ΑΙ αναζητώντας μεγάλα κέρδη χωρίς τεράστιες δαπάνες

Τα 5 πράγματα που δεν πρέπει να μοιράζεστε ποτέ με την τεχνητή νοημοσύνη

To ChatGPT, όπως και άλλα εργαλεία τεχνητής νοημοσύνης, εξελίσσονται χρησιμοποιούνται από όλο και περισσότερους ανθρώπους για μια ευρεία γκάμα αναζητήσεων

Ποιες είναι οι 10 χώρες με τα περισσότερα ταλέντα στην AI

Έρευνα της Microsoft, με τη συμμετοχή 31.000 ατόμων σε 31 χώρες, έδειξε ότι το 66% των επιχειρήσεων δεν θα προσλάμβανε κάποιον χωρίς δεξιότητες στην τεχνητή νοημοσύνη

Η συμβολή της ΑΙ στην κατανόηση της σεισμικής κρίσης στη Σαντορίνη

Τα πρώτα αποτελέσματα της χρήση υψηλής τεχνολογίας και τεχνητής νοημοσύνης στην παρακολούθηση της σεισμικής δραστηριότητας στη Σαντορίνη

Alphabet και Nvidia επενδύουν στην εταιρεία του Σάτσκεβερ, συνιδρυτή της OpenAI

Σύμφωνα με το Reuters, Alphabet και Nvidia επενδύουν στην SSI του Ίλια Σάτσκεβερ που είχε αποχωρήσει πέρυσι από την OpenAI δημιουργό του ChatGTP

Πισσαρίδης (LSE): Η μάχη για την AI κερδίζεται με επενδύσεις και αλλαγές

Για την ανάγκη επενδύσεων στην Τεχνητή Νοημοσύνη και τα βήματα που πρέπει να κάνει η Ευρώπη ώστε να μη χάσει ακόμα περισσότερο έδαφος από τις ΗΠΑ, μίλησε ο Χριστόφορος Πισσαρίδης, Regius Professor, London School of Economics and Political Science

Παπαστεργίου: Ειδική γραμματεία για την AI στο υπουργείο Ψηφιακής Διακυβέρνησης

«Η Ελλάδα είναι ένα τρένο που ξεκινάει σιγά σιγά και θα τρέξει γρήγορα. Το μόνο που πρέπει να κάνουμε είναι να αντιμετωπίσουμε ενδεχόμενα προβλήματα για να μην χάσουμε χρόνο», σημείωσε ο κ. Ππαστεργίου

Η xAI του Μασκ προσλαμβάνει ειδικούς να χαλιναγωγήσουν το αθυρόστομο chatbot

Το Grok εκστομίζει ακατάλληλη φρασεολογία και ρατσιστικά σχόλια

Αριθμός Πιστοποίησης

Αριθμός Πιστοποίησης