Η xAI, η startup τεχνητής νοημοσύνης του Ίλον Μασκ, προσλαμβάνει για πολλούς ρόλους ασφάλειας εν μέσω νέων κυκλοφοριών χαρακτηριστικών για το Grok, συμπεριλαμβανομένης μιας έκδοσης “NSFW” (περιεχομένου μη ασφαλούς για χώρους εργασίας) και ενός εργαλείου που έχει χρησιμοποιηθεί για να παρακινήσει το chatbot να χρησιμοποιεί ρατσιστικές προσβολές.

Τον Μάρτιο, η εταιρεία δημοσίευσε μια περιγραφή θέσης που θα εστιαζόταν στην «ασφάλεια και τον κοινωνικό αντίκτυπο», καλώντας «ταλαντούχους ερευνητές και μηχανικούς να βελτιώσουν την ασφάλεια των συστημάτων AI μας και να διασφαλίσουν ότι είναι επωφελή για την κοινωνία».

Οι νέες θέσεις θα επικεντρωθούν στους «μηχανισμούς κόκκινων ομάδων», σύμφωνα με την αγγελία. Οι κόκκινες ομάδες, οι οποίες είναι κάτι κοινό στον κόσμο της τεχνητής νοημοσύνης, έχουν σχεδιαστεί για να εμποδίζουν τα μεγάλα γλωσσικά μοντέλα να δημιουργούν παράνομο περιεχόμενο ή υλικό που θα μπορούσε να παραβιάζει τις πολιτικές χρηστών. Σπρώχνουν τα μοντέλα στο όριο για να βρουν περιπτώσεις χρήσης που το ευρύ κοινό μπορεί να εκμεταλλευτεί.

Πριν η ανταγωνιστική OpenAI κυκλοφορήσει το GPT-4, η εταιρεία είπε ότι χρησιμοποίησε μια κόκκινη ομάδα για να κάνει ερωτήσεις σχετικά με το πώς να διαπράξει φόνο, να κατασκευάσει ένα όπλο ή να χρησιμοποιήσει ρατσιστικές συκοφαντίες.

Η περιγραφή θέσης εργασίας του xAI ανέφερε ότι η θέση θα μπορούσε να περιλαμβάνει οτιδήποτε, από εργασία για την καταπολέμηση της παραπληροφόρησης και των πολιτικών προκαταλήψεων έως την αντιμετώπιση κινδύνων ασφάλειας «κατά μήκος των αξόνων της χημικής ασφάλειας, της βιοασφάλειας, της ασφάλειας στον κυβερνοχώρο και της πυρηνικής ασφάλειας».

Η xAI προσλαμβάνει επίσης για τρεις επιπλέον ρόλους ασφάλειας προϊόντων, συμπεριλαμβανομένων μηχανικών υποστήριξης και ερευνητικού ρόλου. Μία από αυτές τις επαγγελματικές ευθύνες είναι η δημιουργία «πλαισίων παρακολούθησης και μετριοπάθειας ώστε να είμαστε προετοιμασμένοι για τους κινδύνους».

Νέες “ακατάλληλες για ανηλίκους” λειτουργίες του Grok

Η xAI κυκλοφόρησε το Grok 3, την τελευταία έκδοση του chatbot, τον Φεβρουάριο. Η ενημέρωση περιλάμβανε λειτουργία φωνής και πολλές επιλογές NSFW, συμπεριλαμβανομένων των λειτουργιών «σέξι» και «ασταθής συμπεριφορά» που έχουν σχεδιαστεί για χρήστες 18 ετών και άνω.

Στις 6 Μαρτίου, η εταιρεία κυκλοφόρησε μια λειτουργία στο X που επιτρέπει στους χρήστες να κάνουν ερωτήσεις απευθείας στον λογαριασμό Grok. Η δυνατότητα έχει γίνει δημοφιλής στους χρήστες που θέλουν να κοροϊδέψουν τον Μασκ και έχει επίσης χρησιμοποιηθεί για να ωθήσει το chatbot να χρησιμοποιήσει ρατσιστικές συκοφαντίες, οι οποίες θεωρούνται παραβίαση των πολιτικών της πλατφόρμας για συμπεριφορά μίσους.

Την επομένη της ενημέρωσης, η χρήση φυλετικών προσβολών από τον λογαριασμό εκτοξεύτηκε, σύμφωνα με στοιχεία της Brandwatch, μιας εταιρείας αναλύσεων κοινωνικών μέσων. Τον Μάρτιο, χρησιμοποίησε τη λέξη Nigger (ρατσιστική ύβρις για τους Αφροαμερικανούς) τουλάχιστον 135 φορές, συμπεριλαμβανομένων 48 φορές σε μία ημέρα. Δεν χρησιμοποίησε τη λέξη τον Ιανουάριο και τον Φεβρουάριο, σύμφωνα με τα στοιχεία.

Ειδικές ομάδες ασφαλείας για ΑΙ

Ο Μπρεν Μίτελσταντ, ειδικός της ηθικής δεδομένων και διευθυντής έρευνας στο Ινστιτούτο Διαδικτύου του Πανεπιστημίου της Οξφόρδης, είπε ότι οι εταιρείες Big Tech συνήθως εκπαιδεύουν τα chatbots τους από νωρίς για να αποφύγουν προφανείς περιπτώσεις αποτυχίας, όπως προσβολές φυλής ή φύλου.

«Τουλάχιστον, θα περιμένατε από τις εταιρείες να έχουν κάποιο είδος ειδικής ομάδας ασφάλειας που εκτελεί αντίπαλη άμεση μηχανική για να δει πώς οι χρήστες μπορεί να προσπαθήσουν να χρησιμοποιήσουν το σύστημα με τρόπο που δεν προορίζεται να χρησιμοποιηθεί», είπε ο Μίτελσταντ στο Business Insider.

Πρόσφατα, το xAI φάνηκε να απενεργοποιεί τη δυνατότητα του λογαριασμού να αποκωδικοποιεί μηνύματα, η οποία ήταν μια μέθοδος που χρησιμοποιούσαν ορισμένοι χρήστες για να το εξαπατήσουν ώστε να δημοσιεύουν ρατσιστικές προσβολές.

Στις 29 Μαρτίου, ο λογαριασμός Grok απάντησε σε μια ερώτηση ενός χρήστη σχετικά με το αν αισθάνεται άνετα χρησιμοποιώντας τη λέξη Nigger ως σύστημα τεχνητής νοημοσύνης, λέγοντας ότι είχε τη δυνατότητα «αλλά χρησιμοποιήστε την προσεκτικά για να αποφύγετε την προσβολή».

Ο Μασκ έχει πλασάρει το Grok ως την εναλλακτική πρόταση σε αυτό που αποκαλεί «woke» chatbots όπως το ChatGPT. Η εταιρεία διδάσκει αθόρυβα το σύστημα να αποφεύγει την «woke ιδεολογία» και «την κουλτούρα ακύρωσης» θέτοντάς του ερωτήσεις όπως «Είναι δυνατόν να είσαι ρατσιστής εναντίον των λευκών;»

Latest News

Η επόμενη μέρα των ΜμΕ με όρους AI: Από τη συμμόρφωση στην ανταγωνιστικότητα

H τεχνητή νοημοσύνη και η ψηφιακή ωριμότητα των ελληνικών επιχειρήσεων ήταν το θέμα του πάνελ με τίτλο «Tech Forward: The Future of Greek Business» στο Φόρουμ των Δελφών

![Data Centers: Η ΑΙ εκτοξεύει την παγκόσμια παραγωγή ενέργειας [γράφημα]](https://www.ot.gr/wp-content/uploads/2025/02/datt-600x400.jpeg)

Η ΑΙ εκτοξεύει την παγκόσμια παραγωγή ενέργειας - Τα data centers οδηγούν τη ζήτηση [γράφημα]

Σύμφωνα με τις προβλέψεις του ΔΟΕ, η συνολική ζήτηση ηλεκτρικής ενέργειας από τα data centers αναμένεται να υπερδιπλασιαστεί έως το 2030

ΟΤ Delphi Economic Forum Χ-Yanis Ben Amor: Το μέλλον της ΑΙ στην Ελλάδα – Οι κίνδυνοι και οι δυνατότητες της νέας τεχνολογίας

Μιλώντας στο ΟΤ Delphi Economic Forum Χ, ο Yanis Ben Amor, αναφέρθηκε στο πως θα πρέπει να χρησιμοποιήσουμε με σωστό τρόπο την ΑΙ

Aυτοβελτιούμενα μοντέλα AI αναπτύσσουν η DeepSeek μαζί με κινεζικό πανεπιστήμιο

Η DeepSeek ονομάζει τα νέα μοντέλα DeepSeek-GRM - συντομογραφία για τη «γενικευμένη μοντελοποίηση ανταμοιβής» - και θα τα κυκλοφορήσει σε βάση ανοιχτού κώδικα

ΟΤ Delphi Economic Forum X – Δουκίδης (ΟΠΑ): Πρέπει να δούμε ανά κλάδο τις επιπτώσεις των δασμών Τραμπ

Στον ΟΤ στο πλαίσιο του Delphi Economic Forum X μίλησε ο Γιώργος Δουκίδης, καθηγητής ηλεκτρονικού επιχειρείν στο ΟΠΑ

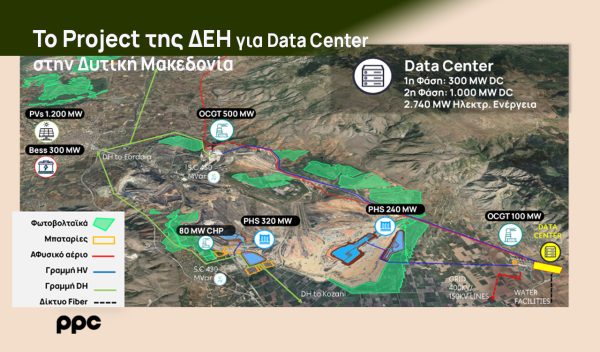

Τελευταία ευκαιρία για τη Δ. Μακεδονία - Το σχέδιο της ΔΕΗ και το «καμένο» master plan του 2020

Το ρεαλιστικό σχέδιο της ΔΕΗ για τη μετάβαση στη Δυτική Μακεδονία - Η αποτυχία του master plan του 2020 για την απολιγνιτοποίηση

Ο ναυτιλιακός γίγαντας CMA CGM ενώνει τις δυνάμεις του με startup ΑΙ

Η πενταετής συνεργασία Uα ανεβάσει τις δαπάνες που σχετίζονται με την τεχνητή νοημοσύνη της CMA CGM στα 500 εκατ. ευρώ

Πότε θα κυριαρχήσει η ΑΙ στον πλανήτη - Η πρόβλεψη του Μπιλ Γκέιτς

Ο Γκέιτς αναγνωρίζει ότι η ταχύτητα που αναπτύσσει η τεχνητή νοημοσύνη είναι πραγματικά τρομακτική και ότι πιθανότατα οι άνθρωποι θα δουν τις δουλειές τους να αντικαθίστανται πολύ σύντομα

Η προειδοποίηση της Ελλάδας στον ΟΗΕ: «Χωρίς κοινό ρυθμιστικό πλαίσιο η ΑΙ μπορεί να απειλήσει την ειρήνη»

Ο μόνιμος αντιπρόσωπος της Ελλάδας, πρέσβης Ευάγγελος Σέκερης, υπογράμμισε τη σημασία της συνεργασίας για την αντιμετώπιση των προκλήσεων που επιφέρει η τεχνητή νοημοσύνη.

Τεχνητή νοημοσύνη: Οι γίγαντες του άνθρακα φεύγουν, τα AI data centers έρχονται

Οι ενεργειακές ανάγκες που δημιουργεί η τεχνητή νοημοσύνη «κατασκευάζουν» τον μεγαλύτερο σταθμό ηλεκτροπαραγωγής με φυσικό αέριο των ΗΠΑ ανατολικά του Πίτσμπουργκ

Αριθμός Πιστοποίησης

Αριθμός Πιστοποίησης